Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Owned by Jörg

KI verstehen. KI nutzen. Superkräfte aktivieren.

Memberships

Bestseller MasterClass

60 members • $197/month

Skoolers

192k members • Free

Community MasterClass

255 members • $99/m

Kourse (Free)

113.2k members • Free

90 contributions to Superkraft KI

🔥 Google verschenkt gerade eine KI, die auf DEINEM Rechner läuft – und kaum jemand bekommt es mit

Vor ein paar Tagen hat Google etwas Bemerkenswertes gemacht: Sie haben Gemma 4 veröffentlicht – eine komplette KI-Modellfamilie, komplett Open Source, unter Apache-2.0-Lizenz. Das bedeutet: Du kannst diese Modelle kostenlos herunterladen, lokal bei dir laufen lassen und sogar kommerziell nutzen. Ohne API-Kosten. Ohne Cloud. Ohne dass deine Daten irgendwohin geschickt werden. Warum das wichtig ist? Weil es die Spielregeln verändert. Was Gemma 4 kann (kurz und knapp): Gemma 4 basiert auf derselben Forschung wie Googles Gemini 3 – also das gleiche Fundament wie Googles Spitzenmodell. Es gibt vier Varianten: zwei kleinere für Smartphones und Laptops (E2B und E4B) und zwei größere für leistungsfähigere Rechner (26B und 31B). Das Modell versteht Text UND Bilder, unterstützt über 140 Sprachen und hat ein Kontextfenster von bis zu 256K Tokens – das ist ein enormes „Gedächtnis" für ein lokales Modell. Und der Clou: Im Vergleich zu Gemma 3 ist der Sprung riesig – bei Coding-Benchmarks zum Beispiel von 110 auf 2.150 ELO. Das ist kein kleines Update, das ist eine andere Liga. Was bedeutet das für dich konkret? Stell dir vor: Du installierst dir eine App (Ollama), tippst einen einzigen Befehl ein – und hast einen KI-Assistenten, der komplett offline auf deinem Rechner läuft. Keine monatlichen Kosten. Keine Daten in der Cloud. Kein Abo. Natürlich ersetzt das nicht Claude oder ChatGPT für komplexe Aufgaben. Aber für viele Alltags-Anwendungen – Texte zusammenfassen, E-Mails vorformulieren, Code schreiben, Bilder analysieren – ist das beeindruckend gut. So probierst du es aus (in 2 Minuten): 1️⃣ Lade Ollama herunter: ollama.com (gibt's für Mac, Windows, Linux) 2️⃣ Öffne das Terminal / die Kommandozeile 3️⃣ Tippe: ollama run gemma4 4️⃣ Fertig. Du chattest jetzt mit einer KI, die lokal auf deinem Rechner läuft. Die Standard-Variante (E4B) ist dabei der Sweet Spot – braucht ca. 10 GB Download und läuft auf den meisten halbwegs aktuellen Rechnern.

1

0

Quizfragen

Hallo mein Name ist Uwe habe gerade mit der ersten Lektion gestartet. Kann mir jemand helfen. Ich finde die erwähnten Quizfragen nicht. Danke

0 likes • 2h

Hallo Uwe, in welchem Kurs bist Du denn? Ich konnte deine Bestellung ja leider nicht finden, vermutlich hast du eine andere Mail Adresse verwendet. :) Ich habe vor kurzem alle Kurse umgezogen; vielleicht ist da irgendwas verloren gegangen, das ist nicht auszuschließen. Dann würde ich das nachreichen. :)

KI als Seelentröster – was können Chatbots wirklich?

Ab heute (01.04.2026) sinken die Honorare für Psychotherapeuten um rund 4,5 Prozent. Gleichzeitig warten Menschen in Deutschland drei bis sechs Monate auf einen Therapieplatz. Kein Wunder, dass immer mehr Leute ihre Sorgen einem Chatbot erzählen. Die DAK-Studie des UKE Hamburg zeigt: Schon jeder zehnte Jugendliche nutzt Chatbots, um über vertrauliche Dinge zu sprechen. Bei Jugendlichen mit depressiven Symptomen sogar jeder Dritte. Funktioniert das? Eine Dartmouth-Studie (veröffentlicht im NEJM AI) hat das erstmals klinisch getestet – mit einem speziell für Therapie trainierten Chatbot namens „Therabot". Ergebnis: 51 Prozent weniger Depressionssymptome nach acht Wochen. Vergleichbar mit klassischer Verhaltenstherapie. Aber Vorsicht: ChatGPT, Claude oder Gemini sind keine Therapeuten. Die sind als Allzweckwerkzeuge gebaut. Die American Psychological Association warnt klar: Allgemeine Chatbots erkennen Krisen oft nicht, verstärken im schlimmsten Fall negative Denkmuster – und unterliegen keiner Schweigepflicht. Was du da reintippst, ist nicht geschützt wie beim Therapeuten. Meine 5 Regeln, wenn ihr Chatbots für seelische Unterstützung nutzt: 1. Ein Chatbot ist kein Therapeut. Bei ernsthaften Problemen: professionelle Hilfe holen. 2. Für leichtere Belastungen durchaus nützlich – Gedanken sortieren, Atemtechniken, Tagebuchersatz. 3. Nicht alles glauben. Chatbots geben euch gerne recht. Das fühlt sich gut an, hilft aber nicht immer. 4. Datenschutz beachten. Keine Klarnamen, keine Befunde reinkippen. Bei ChatGPT in den Einstellungen das Modelltraining deaktivieren. 5. Wer es gezielter will: Apps wie Wysa oder Woebot wurden mit Psychologen entwickelt und haben Krisenprotokolle. Am Ende gilt: Lieber mit einer KI reden als mit niemandem. Aber eine KI sollte die Brücke sein – nicht das Ziel. Telefonseelsorge: 0800 111 0 111 – kostenlos, anonym, rund um die Uhr. Was sind eure Erfahrungen – hat euch ein Chatbot schon mal in einer schwierigen Situation geholfen? Oder seht ihr das kritisch? Schreibt's in die Kommentare.

2

0

🤖 „LLM" – was bedeutet das eigentlich?

Wenn du dich mit KI beschäftigst, stolperst du ständig über diese drei Buchstaben: LLM. ChatGPT ist ein LLM. Claude ist ein LLM. Gemini ist ein LLM. Aber was genau steckt dahinter – und warum ist es wichtig, das zu verstehen? Die Abkürzung LLM steht für Large Language Model – auf Deutsch: großes Sprachmodell. „Groß" ist dabei keine Übertreibung. Die leistungsfähigsten LLMs von heute wurden mit Hunderten Milliarden von Parametern trainiert – das sind die internen Stellschrauben, an denen das Modell dreht, um Sprache zu verstehen und zu erzeugen. Was ein LLM eigentlich macht Im Kern tut ein LLM etwas verblüffend Einfaches: Es sagt das nächste Wort vorher. Immer und immer wieder, Wort für Wort, bis ein ganzer Text entsteht. Klingt simpel? Ist es im Prinzip auch. Aber wenn du dieses simple Prinzip auf eine riesige Datenmenge loslässt – im Grunde große Teile des Internets, Bücher, wissenschaftliche Arbeiten, Wikipedia, Foren, Code –, dann passiert etwas Erstaunliches: Das Modell lernt nicht nur Grammatik und Satzbau, sondern auch Zusammenhänge, Logik, Fachwissen, Humor, Stil und sogar so etwas wie Argumentation. Nicht weil jemand ihm das alles einzeln beigebracht hätte. Sondern weil es aus den Mustern in den Daten Strukturen erkennt, die unglaublich leistungsfähig sind. Wie das Training funktioniert – stark vereinfacht Stell dir vor, du liest dein ganzes Leben lang Bücher – Millionen davon. Irgendwann kannst du einen angefangenen Satz so gut weiterführen, dass er klingt, als käme er aus dem jeweiligen Buch. Du hast nie eine Regel gelernt, aber du hast ein Gespür dafür entwickelt, was als Nächstes kommen sollte. Genau das macht ein LLM, nur in einer Größenordnung, die sich kein Mensch vorstellen kann. Das Training läuft in zwei Phasen: 1. Pre-Training: Das Modell liest riesige Textmengen und lernt dabei, Muster in Sprache zu erkennen. Was folgt typischerweise auf welches Wort? In welchem Kontext? Das dauert Wochen bis Monate und verschlingt Millionen an Rechenkosten.

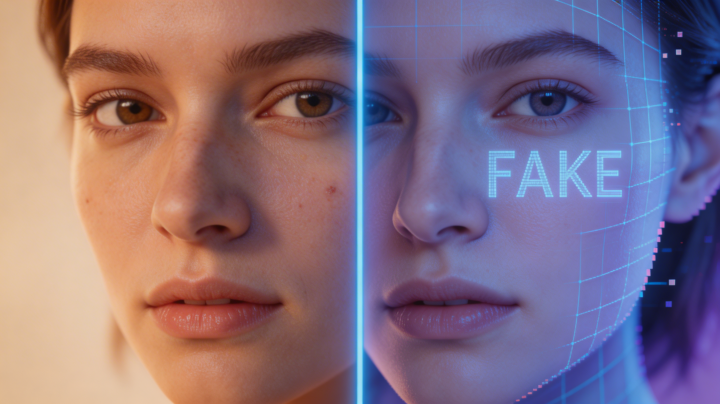

🔍 Deepfakes: Was du jetzt darüber wissen solltest

Deepfakes sind gerade überall in den Nachrichten – wegen des Falls Collien Fernandes, wegen Demos in Berlin und Hamburg, wegen eines Gesetzentwurfs der Bundesregierung. Aber mal ehrlich: Weißt du eigentlich, was genau hinter dem Begriff steckt, wie die Technik funktioniert und warum das Thema gerade jetzt so explodiert? Hier die wichtigsten Hintergründe – kompakt, verständlich und ohne Juristendeutsch. Woher kommt der Begriff? „Deepfake" ist ein Kofferwort aus Deep Learning (eine Methode der Künstlichen Intelligenz) und Fake (Fälschung). Geprägt hat den Begriff Ende 2017 ein anonymer Reddit-Nutzer mit dem Pseudonym „deepfakes". Der hatte mithilfe neuronaler Netze Gesichter von Schauspielerinnen in Pornovideos montiert – und seinen Code einfach öffentlich ins Netz gestellt. Innerhalb weniger Wochen hatte das zugehörige Forum über 90.000 Abonnenten. Reddit hat es dann gesperrt, aber der Geist war aus der Flasche. Der Begriff hat sich seitdem stark geweitet. 2017 meinte man damit nur ganz bestimmte KI-generierte Gesichtertausch-Videos. Heute steht „Deepfake" für praktisch jedes KI-erzeugte oder KI-manipulierte Medium – ob Bild, Video oder Audio. Wie funktionieren Deepfakes technisch? Die Grundlage legte 2014 der Informatiker Ian Goodfellow mit den sogenannten Generative Adversarial Networks (GANs). Das Prinzip ist genial einfach: Zwei neuronale Netze treten gegeneinander an. Das eine erzeugt eine Fälschung, das andere versucht sie zu entlarven. Durch dieses ständige Katz-und-Maus-Spiel werden die Ergebnisse immer besser – bis die Fälschung vom Original kaum noch zu unterscheiden ist. Beim klassischen Face Swap lernt ein sogenannter Autoencoder, wie ein bestimmtes Gesicht aussieht – aus verschiedenen Winkeln, bei verschiedener Beleuchtung, mit unterschiedlicher Mimik. Hat das Netz genug gelernt, kann es dieses Gesicht selbstständig erzeugen und in ein fremdes Video einsetzen. Der Mund bewegt sich synchron, die Mimik passt – täuschend echt. Für Audio-Deepfakes (Voice Cloning) wird die Stimme einer Person analysiert – Tonhöhe, Sprechrhythmus, Betonung – und dann synthetisch nachgebaut. Das Ergebnis: Ein KI-generierter Klon, der klingt wie das Original.

3

0

1-10 of 90

@schieb

Experte für KI und Digitalisierung, Video-Profi | Autor, Speaker, Fernsehen, Radio

Online now

Joined Nov 11, 2025

Düsseldorf

Powered by